把我的手机,红米k60给老爸用了。老爸不适应,转手给弟弟了。他说手机用五年了。该换了正好

尾号5486卡11月16日10:22支出(消费支付宝-献县西收费站)20元,余额10,431.35元。【工商银行】

把我的手机,红米k60给老爸用了。老爸不适应,转手给弟弟了。他说手机用五年了。该换了正好

尾号5486卡11月16日10:22支出(消费支付宝-献县西收费站)20元,余额10,431.35元。【工商银行】

标价6199元,12运行内存512存储。便宜了800元,5399元。农行信用卡支付,又省300元。真实花费5099元。感觉用起来还不错。让自己开心一下。其实红米k60还挺好用。继续用……

昨天陪杜云芳、杨恩智一天,买了辆奇瑞捷途jetour X70 plus(max版)车报价118000元,旧车抵了40000元,交现金15000元,农行贷款8万. (总价4+1.5+8=13.5万—包牌500元+保险4000元+税金1万+优惠3000)

老岳父家里-皇家一里-联通网络欠费,我把自己的闲置的移动宽带已过去了。上午9点就开通了网络。

帮玫町找资料,没找到,和找姐妹生气……他愿意装修地下室!

昨天五矿发资本和第一创业买入在了高点,今天赔了3000!名副其实的高位接盘侠。还不够成熟……继续修炼。

老岳父便秘,十二点半开始,打了开塞露,一下午也没消停,晚上5点半吃饭前,这才排了。

四婶子,四叔送来了花卷、豆包,看上去很诱人!

开车违规:御河路和御景街交叉路口,右转道直行了,被警告,参加学习视频,就不扣分、不扣钱了!谢谢……

康湾集团 固安 牛驼镇

康湾旅居 康湾九华 康湾康养

德,花, 乐,香,书,食,功 七修……

集团 康养 旅养 医养三大版块

远大的新风系统

有机农场 食堂

管家式服务

天津滨海新区第一养护院 失能老人

人体基因检测 提早发现疾病

旅居版块……旅居 旅游 有康养 -联盟 -旅居旅游基地

涿州旅游基地 北海基地 10月第二年3月人多

承德基地 莆田希望集团经营 湄洲岛,像眉毛 成都太保家园 唐山青山关 威海 湖州 南宁华润医养社区。

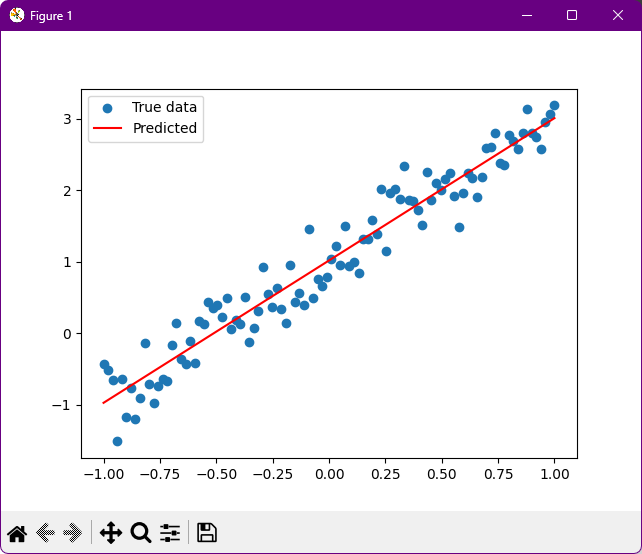

#使用 PyTorch 实现线性回归模型的代码

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

# 生成模拟数据

torch.manual_seed(42)

x = torch.linspace(-1, 1, 100).view(-1, 1)

y = 2 * x + 1 + 0.3 * torch.randn(x.size())

# 定义线性回归模型

class LinearRegressionModel(nn.Module):

def __init__(self):

super(LinearRegressionModel, self).__init__()

self.linear = nn.Linear(1, 1)

def forward(self, x):

return self.linear(x)

model = LinearRegressionModel()

# 定义损失函数和优化器

criterion = nn.MSELoss()

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

# 训练模型

epochs = 1000

for epoch in range(epochs):

optimizer.zero_grad()

outputs = model(x)

loss = criterion(outputs, y)

loss.backward()

optimizer.step()

if (epoch + 1) % 100 == 0:

print(f'Epoch [{epoch + 1}/{epochs}], Loss: {loss.item()}')

# 进行预测

with torch.no_grad():

predicted = model(x)

# 绘制结果

plt.scatter(x.numpy(), y.numpy(), label='True data')

plt.plot(x.numpy(), predicted.numpy(), 'r', label='Predicted')

plt.legend()

plt.show()

'''

在这段代码中,首先生成了模拟的线性数据,并添加了一些噪声。

然后定义了一个线性回归模型,包含一个线性层。

接着使用均方误差损失函数和随机梯度下降优化器进行模型训练。

最后,进行预测并绘制出真实数据和预测结果的对比图。

'''

#使用 PyTorch 在 GPU 上进行线性回归的代码实例

import torch

import torch.nn as nn

import torch.optim as optim

# 设置设备为 GPU(如果可用)

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(f'Using device: {device}')

# 生成模拟数据

torch.manual_seed(42)

x = torch.randn(100, 1).to(device)

y = 3 * x + 2 + torch.randn(100, 1).to(device)

# 定义线性回归模型

class LinearRegression(nn.Module):

def __init__(self):

super(LinearRegression, self).__init__()

self.linear = nn.Linear(1, 1)

def forward(self, x):

return self.linear(x)

model = LinearRegression().to(device)

# 定义损失函数和优化器

criterion = nn.MSELoss()

optimizer = optim.SGD(model.parameters(), lr=0.01)

# 训练模型

num_epochs = 1000

for epoch in range(num_epochs):

# 将数据和模型都移到 GPU

inputs = x.to(device)

targets = y.to(device)

outputs = model(inputs)

loss = criterion(outputs, targets)

optimizer.zero_grad()

loss.backward()

optimizer.step()

if (epoch + 1) % 100 == 0:

print(f'Epoch [{epoch+1}/{num_epochs}], Loss: {loss.item()}')

# 在 GPU 上进行预测

with torch.no_grad():

test_input = torch.tensor([[4.0]]).to(device)

predicted = model(test_input)

print(f'Predicted value for input 4.0: {predicted.item()}')

'''

在这个例子中,首先检查是否有可用的 GPU,如果有则将设备设置为 GPU。

然后生成模拟数据并将其移到 GPU 上。定义线性回归模型并将其也移到 GPU。

使用均方误差损失函数和随机梯度下降优化器进行模型训练。最后,在 GPU 上进行预测并输出结果。

'''

[Running] python -u “d:\python\torch_gpu.py”

Using device: cpu

Epoch [100/1000], Loss: 0.917326033115387

Epoch [200/1000], Loss: 0.7827349305152893

Epoch [300/1000], Loss: 0.7804043292999268

Epoch [400/1000], Loss: 0.7803614735603333

Epoch [500/1000], Loss: 0.7803605794906616

Epoch [600/1000], Loss: 0.7803605794906616

Epoch [700/1000], Loss: 0.7803606390953064

Epoch [800/1000], Loss: 0.7803606390953064

Epoch [900/1000], Loss: 0.7803606390953064

Epoch [1000/1000], Loss: 0.7803606390953064

Predicted value for input 4.0: 14.082897186279297

[Done] exited with code=0 in 2.915 seconds